Analog AI承诺初创公司可以在PC上提供强大的功能

2025-06-05 10:53

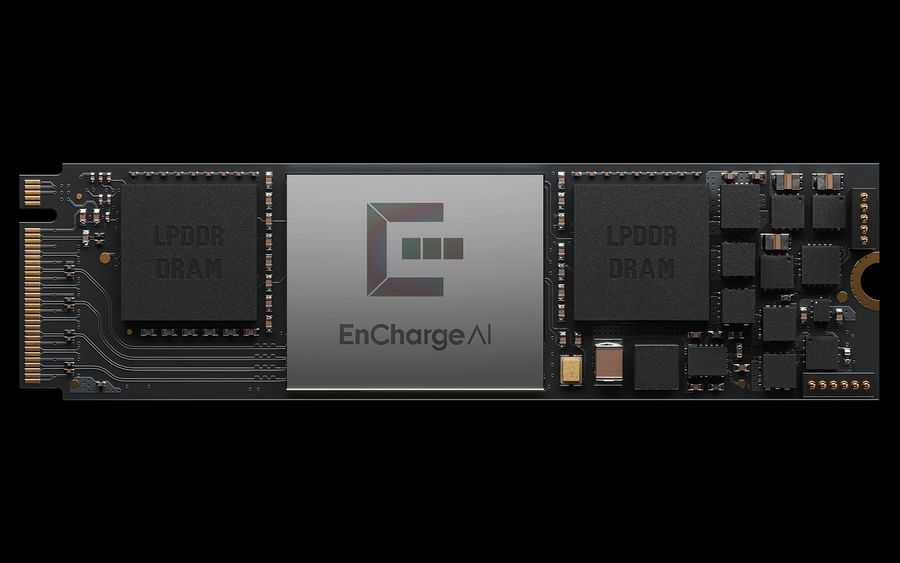

普林斯顿大学的Naveen Verma的实验室就像一个博物馆一样,它展示了工程师试图通过使用模拟现象比数字计算来改善AI的超经济学。在工作台中,是有史以来最有效的能量。在另一个位置,您会找到一个基于内存的芯片,该芯片计算迄今为止任何AI模拟系统中最大的数字矩阵。 Verma引用了本文,他说也没有商业前景。并非如此,他的实验室的这一部分是一个公墓。多年来,Analog AI吸引了芯片建筑师的想象。它结合了两个基本概念,这些概念应大大降低机器学习的强度强度。首先,它限制了内存和处理器内存之间的昂贵运动。其次,这不是逻辑1和0s,而是电流的物理学用于很好地学习机器。虽然这个想法是有吸引力的 - 多种AI模拟解决方案的实施方式并没有真正消除AI能量的令人震惊的食欲。 Velma会知道的。他尝试了一切。但是,当一年前IEEE频谱访问时,Verma Labs背后有一个芯片,这代表了对AI限制的希望,并且对使AI有益且普遍存在所需的能量进行了出色的计算。芯片不是使用电流计算的,而是电荷组成的。这似乎是无关的差异,但是要克服防止所有其他模拟解决方案和SA AI的噪声可能是关键。本周,Verma初创公司Launs Launs Launs Encharge AI基于此新建筑,这是第一个芯片EN100。 Startup表示,芯片可以处理各种AI工作,并且每瓦的芯片比竞争对手的芯片高20倍。它设计为单个处理器卡,每秒增加了200万亿瓦的操作,至8.25瓦,旨在扩大支持AI的笔记本电脑的电池寿命。最重要的ly,一张4芯片卡,每秒1,000万亿个操作对AI工作站的目标。目前,巧合的是,机器的学习是“事实证明是愚蠢的运气,我们要做的主要是将矩阵倍增。”它通常需要一组数字,将其乘以另一个数组,并添加所有这些复制品的结果。 Maagafter All,工程师注意到一个团结:电气工程的两个基本政策可以准确地完成此任务。欧姆法律说,您可以通过乘电压和行为来获得最新。基洛夫(Kieloff)目前的法律指出,如果一堆波浪从一堆电线进入点,这些波浪的总和将留下这一点。因此,实际上,每串输入电压都通过电阻驱动电流(行为是电阻的奖励),乘以电压量,所有这些波增加以产生值。数学,结束了。听起来不错?好吧,会更好。组成神经网络的大多数数据是“我们即“要增加数据的输入”。从内存到处理器的逻辑传输到完成这项工作的逻辑,提供了GPU消耗的大部分能量。相反,在大多数模拟AI方案中,大多数模拟AI方案,重量都可以作为电导率值(上面的电阻值)存储在不需要的位置,而不是blur blur blur blur to to blur blur to to blur blur the as to blur blur,因为它是blur的。不幸的是,有很多能量可以实现自由数学和稳定的状态数据,而不幸的是,这不是AI的主要问题的主要问题。来源。Verma说:“假设您有一个模拟神经网络,将重量作为行为存储在单个RRAM电池中。通过将RRAM电池中相对较高的电压设置为指定的时间段内,可以存储此类重量值。问题是,问题是,在两个电池中,在两个电池中都可以在两个电池上设置两个电池的电压,并且这些电池均与这些电池相同的范围较差,而这些电池的行为却差不多。温度可能很小,但是请记住,操作会增加很多,因此噪声会更糟,然后将生成的电流转换为电压,作为对下一个神经网络的输入,进一步增加了噪音。其他公司致力于制造具有尽可能预测行为的设备。 IBM都在这一领域进行了广泛的研究。这些技术在较小的系统中具有竞争力,尽管在广告中不良,但这些芯片旨在为物联网网络侧面的设备提供低强度研究。早期的参赛神话AI制作了一代以上的模拟AI芯片,但它在Fieldan成功的低强度数字芯片中竞争。 PC的EN100卡是模拟AI芯片的新架构。通过研究机器学习的乘法来测量电荷量而不是电荷流,以所有encharge解决方案来消除噪声,以消除噪声。在传统的AI类似物中,增加取决于电压,行为和电流之间的关系。在这个新解决方案中,它取决于电压,容量和电荷之间的链接,而电荷等于CA很重要。能力乘以电压。为什么这种差异很重要?这取决于执行繁殖操作的成分。 Encharge不使用Rraang M之类的东西是一种关键的,弱的设备,而是使用电容器。电容器通常是夹在绝缘体中的两个导体。导体之间的电压差会带来一个电荷积聚在一个导体中。对于机器研究,他们的关键是其价值(容量)取决于它们的尺寸。 (导体之间的较大导体区域或较小的空间意味着更大的容量。M Samsung Venture,Foxconn等)计划NA还有另一个早期的合作。但是,恩菲格(Encharge)与大型竞争对手卡胡纳(Kahuna)Nvidia进入了一个高度竞争的领域。在3月GTC开发人员的重大活动中,NVIDIA宣布了计划在GB10 CPU-GPU投资组合周围建造PC产品,并在即将到来的GB300周围建造工作站。在低调的地区将会有很多竞争。其中一些还使用某些形式的内存计算。例如,D-Matrix和Axelera继承了模拟AI将内存嵌入计算中的承诺,但要做数字化的所有操作。每个人都开发了可以存储和乘以数字方式的自定义SRAM存储单元。即使是更传统的模拟AI初创公司也称为Sagence。毫不奇怪,Verma是乐观的。他在一份陈述中说,技术前“意味着先进,安全和个性化的AI在本地运行,而无需依靠云基础架构。” “我们希望它将开始抛弃您可以使用AI的功能。”

普林斯顿大学的Naveen Verma的实验室就像一个博物馆一样,它展示了工程师试图通过使用模拟现象比数字计算来改善AI的超经济学。在工作台中,是有史以来最有效的能量。在另一个位置,您会找到一个基于内存的芯片,该芯片计算迄今为止任何AI模拟系统中最大的数字矩阵。 Verma引用了本文,他说也没有商业前景。并非如此,他的实验室的这一部分是一个公墓。多年来,Analog AI吸引了芯片建筑师的想象。它结合了两个基本概念,这些概念应大大降低机器学习的强度强度。首先,它限制了内存和处理器内存之间的昂贵运动。其次,这不是逻辑1和0s,而是电流的物理学用于很好地学习机器。虽然这个想法是有吸引力的 - 多种AI模拟解决方案的实施方式并没有真正消除AI能量的令人震惊的食欲。 Velma会知道的。他尝试了一切。但是,当一年前IEEE频谱访问时,Verma Labs背后有一个芯片,这代表了对AI限制的希望,并且对使AI有益且普遍存在所需的能量进行了出色的计算。芯片不是使用电流计算的,而是电荷组成的。这似乎是无关的差异,但是要克服防止所有其他模拟解决方案和SA AI的噪声可能是关键。本周,Verma初创公司Launs Launs Launs Encharge AI基于此新建筑,这是第一个芯片EN100。 Startup表示,芯片可以处理各种AI工作,并且每瓦的芯片比竞争对手的芯片高20倍。它设计为单个处理器卡,每秒增加了200万亿瓦的操作,至8.25瓦,旨在扩大支持AI的笔记本电脑的电池寿命。最重要的ly,一张4芯片卡,每秒1,000万亿个操作对AI工作站的目标。目前,巧合的是,机器的学习是“事实证明是愚蠢的运气,我们要做的主要是将矩阵倍增。”它通常需要一组数字,将其乘以另一个数组,并添加所有这些复制品的结果。 Maagafter All,工程师注意到一个团结:电气工程的两个基本政策可以准确地完成此任务。欧姆法律说,您可以通过乘电压和行为来获得最新。基洛夫(Kieloff)目前的法律指出,如果一堆波浪从一堆电线进入点,这些波浪的总和将留下这一点。因此,实际上,每串输入电压都通过电阻驱动电流(行为是电阻的奖励),乘以电压量,所有这些波增加以产生值。数学,结束了。听起来不错?好吧,会更好。组成神经网络的大多数数据是“我们即“要增加数据的输入”。从内存到处理器的逻辑传输到完成这项工作的逻辑,提供了GPU消耗的大部分能量。相反,在大多数模拟AI方案中,大多数模拟AI方案,重量都可以作为电导率值(上面的电阻值)存储在不需要的位置,而不是blur blur blur blur to to blur blur to to blur blur the as to blur blur,因为它是blur的。不幸的是,有很多能量可以实现自由数学和稳定的状态数据,而不幸的是,这不是AI的主要问题的主要问题。来源。Verma说:“假设您有一个模拟神经网络,将重量作为行为存储在单个RRAM电池中。通过将RRAM电池中相对较高的电压设置为指定的时间段内,可以存储此类重量值。问题是,问题是,在两个电池中,在两个电池中都可以在两个电池上设置两个电池的电压,并且这些电池均与这些电池相同的范围较差,而这些电池的行为却差不多。温度可能很小,但是请记住,操作会增加很多,因此噪声会更糟,然后将生成的电流转换为电压,作为对下一个神经网络的输入,进一步增加了噪音。其他公司致力于制造具有尽可能预测行为的设备。 IBM都在这一领域进行了广泛的研究。这些技术在较小的系统中具有竞争力,尽管在广告中不良,但这些芯片旨在为物联网网络侧面的设备提供低强度研究。早期的参赛神话AI制作了一代以上的模拟AI芯片,但它在Fieldan成功的低强度数字芯片中竞争。 PC的EN100卡是模拟AI芯片的新架构。通过研究机器学习的乘法来测量电荷量而不是电荷流,以所有encharge解决方案来消除噪声,以消除噪声。在传统的AI类似物中,增加取决于电压,行为和电流之间的关系。在这个新解决方案中,它取决于电压,容量和电荷之间的链接,而电荷等于CA很重要。能力乘以电压。为什么这种差异很重要?这取决于执行繁殖操作的成分。 Encharge不使用Rraang M之类的东西是一种关键的,弱的设备,而是使用电容器。电容器通常是夹在绝缘体中的两个导体。导体之间的电压差会带来一个电荷积聚在一个导体中。对于机器研究,他们的关键是其价值(容量)取决于它们的尺寸。 (导体之间的较大导体区域或较小的空间意味着更大的容量。M Samsung Venture,Foxconn等)计划NA还有另一个早期的合作。但是,恩菲格(Encharge)与大型竞争对手卡胡纳(Kahuna)Nvidia进入了一个高度竞争的领域。在3月GTC开发人员的重大活动中,NVIDIA宣布了计划在GB10 CPU-GPU投资组合周围建造PC产品,并在即将到来的GB300周围建造工作站。在低调的地区将会有很多竞争。其中一些还使用某些形式的内存计算。例如,D-Matrix和Axelera继承了模拟AI将内存嵌入计算中的承诺,但要做数字化的所有操作。每个人都开发了可以存储和乘以数字方式的自定义SRAM存储单元。即使是更传统的模拟AI初创公司也称为Sagence。毫不奇怪,Verma是乐观的。他在一份陈述中说,技术前“意味着先进,安全和个性化的AI在本地运行,而无需依靠云基础架构。” “我们希望它将开始抛弃您可以使用AI的功能。” 相关推荐

Copyright © 2024-2026 365游戏中心官网_365电子游戏app 版权所有

+86-123-4567

+86-123-4567 天朝天堂路99号

天朝天堂路99号